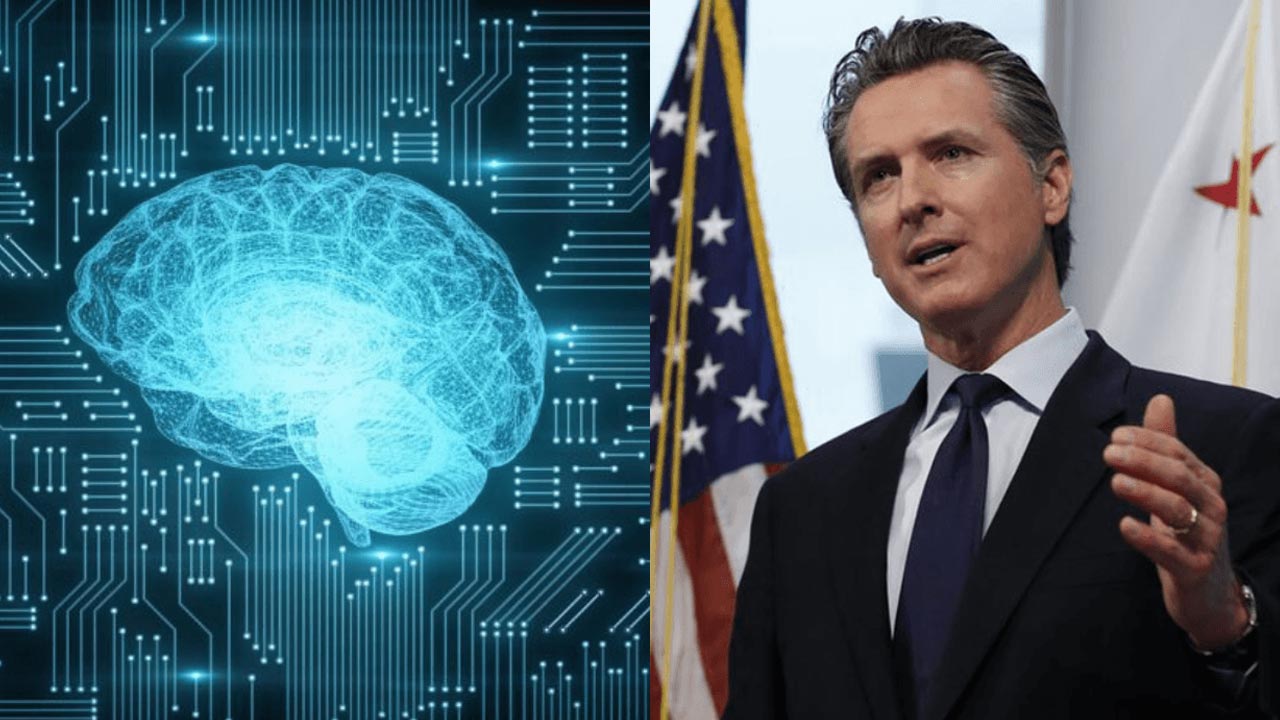

Sacramento, California, EE.UU. — En un paso trascendental hacia la regulación tecnológica, el gobernador Gavin Newsom firmó la nueva ley estatal SB 53, que obliga a las grandes empresas de inteligencia artificial (IA) a revelar públicamente sus protocolos de seguridad, monitorear sus sistemas más avanzados y reportar incidentes críticos, con el fin de prevenir riesgos mayores para la sociedad.

Según lo dispuesto por la legislación, aquellos sistemas de IA que superen ciertos umbrales de “computación de frontera” (“frontier”) deberán someterse a exámenes de seguridad más rigurosos, y cualquier evento que potencialmente ponga en riesgo infraestructura crítica o cause daños significativos deberá notificarse en un plazo de 15 días. Las sanciones por incumplimiento podrían alcanzar multas de hasta un millón de dólares, contemplándose además mecanismos de protección para denunciantes internos que alerten sobre vulneraciones.

El senador estatal Scott Wiener, autor del proyecto, advirtió que esta normativa busca ser un equilibrio entre fomento a la innovación y resguardo de la seguridad pública. “Con una tecnología tan transformadora como la IA, tenemos la responsabilidad de apoyar la innovación mientras implementamos medidas de seguridad sensatas”, declaró Wiener al presentar la iniciativa.

El antecedente legislativo no fue menor: en una ocasión previa, Newsom vetó una propuesta más ambiciosa, ante la preocupación de que las nuevas regulaciones pudieran afectar la competitividad del estado como núcleo tecnológico. Esta vez, el marco legal fue construido con retroalimentación de expertos en seguridad de IA y del sector tecnológico, buscando generar consensos necesarios para que la ley no inhiba la capacidad de innovación.

California, cuna de algunas de las compañías de IA más influyentes del mundo (OpenAI, Anthropic, Google, Meta, entre otras), ahora establece una regulación pionera que podría servir de modelo para otros estados en Estados Unidos y a escala global.

Queda por ver cómo se implementarán los procesos de auditoría, supervisión y penalización, y en qué medida la norma logrará disuadir usos nefastos de la IA — desde ciberataques a infraestructuras hasta el desarrollo de armas — sin obstaculizar el ritmo de avances tecnológicos. Con esta firma, California reafirma su intención de liderar no solo en innovación, sino en regulación responsable del futuro digital.